同业险些每个月皆在发布大模子开源音问,腾讯的近似新闻则发生在6个月前。11月5日,腾讯将MoE模子“混元Large”以及混元3D生成大模子“Hunyuan3D-1.0”认真开源,这两个模子已在腾讯业务场景落地,维持企业及成立者精调、部署等不同场景的使用需求。

“慢工出细活”,腾讯机器学习平台总监,腾讯混元大言语模子算法负责东谈主康战辉向媒体先容新开源的MoE模子“混元Large”时暗示;“不是什么皆唯快不破”,7月腾讯集团高档推行副总裁汤谈生谈到大模子C(用户)端家具元宝上线时间时说。适值的是,第三方机构QuestMobile11月5日流露的AIGC(东谈主工智能生成内容)App月活数据涌现,9月豆包、文小言、Kimi等名次前十,元宝不在榜单中。

腾讯混元Large模子总参数目389B,激活参数目52B,高下文长度256K。除了这些大模子的惯例数据,康战辉在3个多小时的换取会上屡次强调MoE架构。“腾讯混元Large是当今开源鸿沟参数鸿沟最大、后果最佳的MoE模子。”

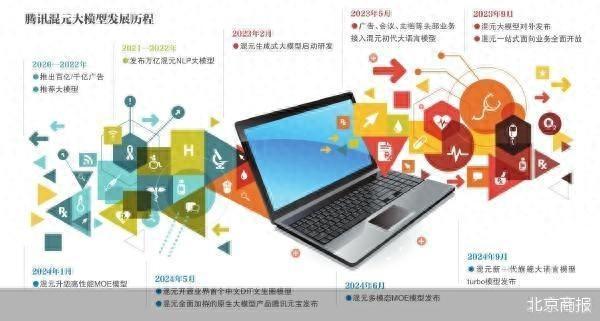

MoE(Mixture of Experts),即羼杂群众模子,是当今国表里主流的大模子结构。2024岁首,腾讯混元秘书在国内最初采取MoE架构模子,总体性能比上一代Dense模子晋升50%。而后,腾讯混元推出基于MoE架构的多模态清醒大模子以及基础模子“混元turbo”。

之是以强调MoE架构,“是因为腾讯作念MoE架构很早,咱们很早发现这里面的后劲,是以一直在陆续”,康战辉讲明注解,“本体上来讲,MoE是一个高性价比的东西,同等算力下,模子参数目越大,MoE的性价比更高,更合乎复杂的任务。Dense模子的上风在于完成一些相对直快的任务”。

不外康战辉也暗示,“架构的遴荐永久看是同归殊涂,罗马在那边是很明晰的,路怎么走各家不相似”。

另一款开源的腾讯混元3D生成大模子,首批包含轻量版和四肢版,轻量版仅需10s即可生成高质料3D财富,当今已在时刻社区公成立布,包含模子权重、推理代码、模子算法等完竣模子,可供成立者、谈判者等各样用户免费使用。

在诈欺层面,腾讯混元3D模子负责东谈主郭春超先容,当今腾讯3D生成联系时刻依然运行诈欺于UGC 3D创作、商品素材合成、游戏3D财富生成等腾讯业务中。腾讯舆图基于腾讯混元3D大模子,发布了自界说3D导航车标功能,维持用户创作个性化的3D导航车标,比拟传统的3D车标重建决议,速率晋升了91%。

关于开源节律,腾讯莫得掩藏,气魄是“不急于为了开源而开源”“在里面业务打磨好再开源”“要开就要有忠心,与公司内诈欺模子同宗同源”。

议论扩充战略和营收等则不是腾讯本日的要点,“开源成心于大模子厂商变成更通达的生态,诱骗到更多谈判者或成立者来丰富基于这些模子的诈欺和管事,相应地也能激动模子合手续地优化迭代。尽管模子本人是开源的,但仍然不错在这个基础上提供多种神气的管事,包括定制成立、时刻维持、培训等”。易不雅分析谈判结伴东谈主陈晨告诉北京商报记者。

北京商报记者 魏蔚